KI wird im Frieden über Krise bis zum Krieg eingesetzt, beispielsweise in der militärischen Aufklärung. Dadurch können große Datenmengen analysiert werden, um Muster zu erkennen und so potenzielle Bedrohungen zu identifizieren.

Weiterhin werden KI-basierte Frühwarnsysteme genutzt, um geopolitische Risiken oder Instabilitäten durch die Analyse von Nachrichten und sozialen Medien zu erkennen. Die Bereiche Simulation, Training, Ausbildung und die Unterstützung bei administrativen Routineaufgaben sind weitere Einsatzbereiche, in denen KI-Systeme Schritt für Schritt integriert werden.

Bereits heute ist in der modernen Kriegsführung die Nutzung von KI omnipräsent. In den Medien erscheinen täglich Berichte von unbemannten Systemen, die mit Unterstützung von Künstlicher Intelligenz wirksamere Aufklärungsmissionen und Angriffe durchführen. Ähnlich verhält es sich mit Entscheidungsunterstützungssystemen, die Soldaten helfen, bessere Entscheidungen im militärischen Bekämpfungsprozess schneller zu treffen.

Multi Domain Operations (MDO) befähigen die Bundeswehr zukünftig, im Rahmen einer gesamtstaatlichen Verteidigung in künftigen Einsatzumfeldern zu bestehen und kriegstüchtig zu werden. MDO sind die Weiterentwicklung bündnisweiter Joint Operations, ausgerichtet auf Effekte im digitalen Zeitalter. KI ist für MDO die zentrale „enabling technology“, ohne die MDO aufgrund der Komplexität und der Masse an zu verarbeitenden Daten nicht erfolgreich sein können.

Internationale Governance für KI – ein Rahmen im Entstehen

Eine Erkenntnis aus der Menschheitsgeschichte ist, dass sich (Waffen)Technologie und Politische Ordnung in einem ständigen Dialog symbiotisch entwickeln. Die Einführung neuer Technologien hat erhebliche politische und (militär)strategische Konsequenzen.

Da demokratische und freie Gesellschaften verwundbar sind und Schutzmechanismen benötigen, muss uns der Höhepunkt der sich weiter aufbauenden KI-Hightech-Welle deswegen möglichst kontrolliert erreichen, um negative gesellschaftliche Umbrüche zu verhindern oder zumindest einzudämmen und abzumildern.

Insbesondere die zunehmende Entwicklung KI-unterstützter Funktionen in Waffensystemen und die künftige Rolle von KI bei der Entscheidungsfindung stellen die Frage der Verantwortlichkeit für aus deren Anwendung resultierender Folgen. Damit wirft die verantwortungsvolle militärische Nutzung von KI tiefgreifende ethische und rechtliche Fragen auf. Die Beantwortung dieser Fragen erfolgt durch internationale Normenbildung, insbesondere in den Vereinten Nationen, der NATO und der EU.

Unverändert unterliegen die Entwicklung, Einführung und Nutzung von KI in der Bundeswehr dem anwendbaren nationalen und internationalen Recht. Auch hinsichtlich KI-Systemen sind die geltenden rechtlichen Verpflichtungen in allen Bereichen einzuhalten. Dies gilt vom Arbeitsrecht über Datenschutz und Beschaffung bis hin zum humanitären Völkerrecht in bewaffneten Konflikten.

Die Einführung von Waffensystemen mit KI-Anteilen in die Bundeswehr erfolgt entlang der Anforderungen des Art. 36 des I. Zusatzprotokolls von 1977 zu dem Genfer Abkommen von 1949, wonach Deutschland verpflichtet ist, bei der Prüfung, Entwicklung, Beschaffung oder Einführung neuer Waffen oder neuer Mittel oder Methoden der Kriegsführung festzustellen, ob ihre Verwendung stets oder unter bestimmten Umständen verboten ist.

Um diesem Umstand Rechnung zu tragen, besteht im BMVg der Steuerkreis Prüfung neuer Waffen und Methoden der Kriegsführung. Es gibt also keinen rechtsfreien Raum, kein „rechtliches Vakuum“ für die Nutzung von KI in der Bundeswehr.

Zuletzt hat Deutschland anlässlich des AI Action Summits in Paris mit der Unterzeichnung der „Paris Declaration on Maintaining Human Control in AI enabled Weapon Systems“ im Februar 2025 erneut betont, dass Verantwortung und Rechenschaftspflicht niemals auf Maschinen übertragen werden können.

Betont wurde auch die Sicherstelltung, dass Menschen für die Entwicklung, den Einsatz und die Nutzung von KI-Anwendungen im militärischen Bereich verantwortlich und rechenschaftspflichtig bleiben, und dass wir geeignete Sicherheitsvorkehrungen in Bezug auf das menschliche Urteilsvermögen und die Kontrolle über die Anwendung von militärischer Gewalt treffen. Die Entwicklung klarer ethischer Richtlinien und Verantwortlichkeitsstrukturen ist dafür unerlässlich.

Deutschland bringt sich dazu in die internationalen Gremien ein und gestaltet den internationalen Ordnungsrahmen im Rahmen der Vereinten Nationen, aber auch in anderen internationalen Initiativen aktiv mit. Dazu gehört beispielsweise das deutsche Engagement zur Regulierung von letalen autonomen Waffensystemen (LAWS) im Rahmen einer VN-Regierungsexpertengruppe.

Im zivilen Bereich erleben wir ebenfalls die Kodifizierung supranationaler und internationaler Regelungen für Staaten und Unternehmen wie die EU KI-Verordnung und die KI-Rahmenkonvention des Europarates, deren Regelungspflichten jedoch nicht für den Verteidigungsbereich gelten. Komplementierend werden politische Erklärungen verabschiedet, wie z. B. der UN Global Digital Compact, verschiedene Resolutionen der VN-Generalversammlung, Schlussdokumente der AI Safety/Action Summit Serie, usw..

Die Bereiche Militär, Verteidigung und nationale Sicherheit sind aufgrund ihrer Besonderheiten richtigerweise regelmäßig von diesen internationalen zivilen Regelungen und Erklärungen ausgenommen, da diese auf besondere internationale Vorschriften für das Militär verweisen.

Aber wo finden sich diese Regelwerke für KI im Verteidigungsbereich? Sie befinden sich in der Entstehung. So sind akademische Institute gerade dabei, ein Manual on the International Law applicable to AI Warfare zu schreiben, von seiner Wirkmächtigkeit her sicherlich vergleichbar mit dem Tallinn Manual on the International Law applicable to Cyber Warfare. Auch sind mehrere internationale Governance-Initiativen für KI dabei, in diesem Bereich Normen und Standards zu entwickeln, und das BMVg ist an allen relevanten Initiativen beteiligt.

So arbeitet Deutschland aktiv mit im NATO Data and AI Review Board und hat die NATO Revised AI Strategy von 2024, die einer unserer wichtigsten Bezugspunkte für KI im Verteidigungsbereich ist, substantiell mitgestaltet. Sie enthält insbesondere die Principles for Responsible Use of AI, die leitend für die Implementierung und Operationalisierung von KI in den Streitkräften sind.

Mit Unterzeichnung der internationalen Political Declaration on the Responsible Military Use of Artificial Intelligence and Autonomy im November 2023 bekennt sich Deutschland zur verantwortungsvollen Nutzung von KI im Verteidigungsbereich. Durch Übernahme des Co-Vorsitzes der Oversight Working Group zur Political Declaration im April 2024 gestaltet das BMVg dazu wichtige Bereiche führend mit.

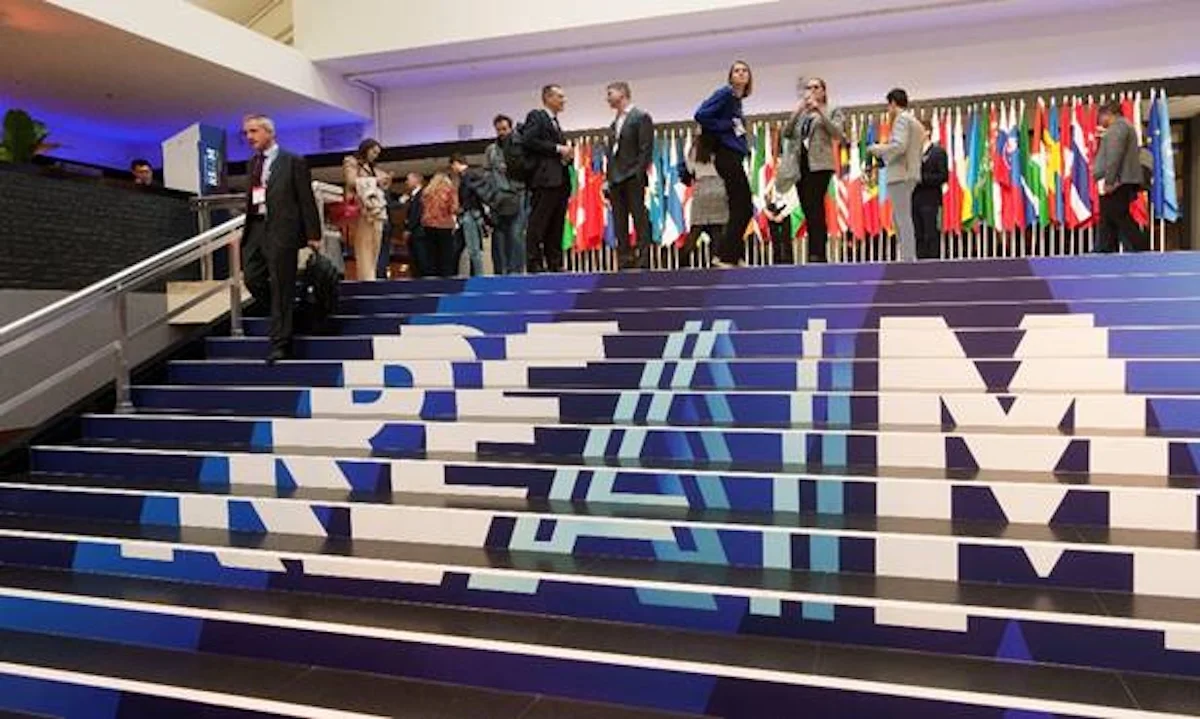

Dazu gehören Implementierungsstrategieentwicklung, Legal Compliance, Verbesserung des Schutzes von Zivilpersonen und ziviler Infrastruktur sowie Überwachung der Entwicklung und Einführung von KI-Anwendungen in Waffensystemen. Flankiert wird dies durch die aktive Mitarbeit im REAIM-Prozess (Responsible Use of AI in the Military Domain) und Unterzeichnung der politischen Abschlusserklärung REAIM Blueprint for Action im September 2024.

Daraus hervor ging die erste Resolution 79/239 (2024) der VN-Vollversammlung zum Thema „Artificial intelligence in the military domain and ist implications for international peace and security“. Als Teil der Kerngruppe von Co-Sponsoren hat Deutschland diese maßgeblich unterstützt. Folgerichtig ist Deutschland im United Nations Institute for Disarmament Research Expert Network on Governance of Artificial Intelligence in the Military Domain vertreten. Denn dort bauen die Staaten ein Netzwerk auf, welches die Inhalte der vorgenannten Initiativen auf Ebene der Vereinten Nationen wahrnimmt.

Auf operativ-taktischer Ebene engagiert sich Deutschland durch die aktive Mitarbeit im internationalen AI Partnership for Defence. Diese hat das Ziel, die verantwortungsvolle militärische Nutzung von Künstlicher Intelligenz im Verteidigungsbereich unter gleichgesinnten Staaten zu operationalisieren.

Im EU-Rahmen verfolgt Deutschland den Ansatz einer Military Roadmap for the Introduction of AI in the Military Field, wobei die Zusammenarbeit mit der NATO besonders betont wird.

Verantwortungsvolle militärische Nutzung von KI im Bündnis – zukünftige Basis der Interoperabilität

In der NATO-KI-Strategie wurden bereits 2021 Prinzipien für die verantwortungsvolle Nutzung von Künstlicher Intelligenz definiert, die zukünftig Grundlage für den gemeinsamen Einsatz von KI und damit unerlässlicher Teil der Interoperabilität im Bündnis sind. Für die Validierung der Einhaltung der Prinzipien in Projekten werden derzeit gemeinsam im Bündnis Werkzeuge erarbeitet.

Damit entsteht ein konkreter Handlungsrahmen für die gemeinsame Validierung, Evaluierung und Testung von KI im Bündnis, welcher für die Bundeswehr maßgeblich ist. Über die Frage der Einhaltung von ethischen Standards hinaus, sind auch die Fragen von Sicherheit und Resilienz gegen gegnerische Cyber-Angriffe auf Daten und KI-Modelle dabei zu betrachten.

Zudem bleibt für die Bundeswehr die Anwendung der Prinzipien der Inneren Führung unverzichtbar. Unverändert gilt auch die Beachtung des für die Bundeswehr leitenden Grundsatzes der Einheit von militärischer Operationsführung und Recht.

Die Entwicklung von verantwortungsvoll nutzbaren KI-Fähigkeiten kann uns nur gelingen, wenn die Kooperation mit der Industrie auf europäischer und transatlantischer Ebene verstärkt und kontinuierlich weiterentwickelt wird. Damit einher gehen die Entwicklung und Einhaltung von NATO- und EU- Standards, die Ausbildung von Fachkräften und die Steigerung von Kompetenzen bei der Nutzung von Künstlicher Intelligenz. Die ethischen, rechtlichen und politischen Rahmenbedingungen werden ausgewertet, die Ausbildungslandkarte sowie das soldatische Mindset werden den neuen Entwicklungen angepasst.

Konzeptionelle Umsetzung in der Bundeswehr

Die Entwicklung von KI verläuft derzeit rasant und führt zu einer kontinuierlichen und umfassenden Wahrnehmung für die effektive Planung und Steuerung im Verteidigungsressort durch das BMVg. In diesem Bewusstsein wird derzeit die „Konzeption Nutzung und Governance KI im Geschäftsbereich BMVg“ fortgeschrieben, welche sich mit den relevanten Handlungsfeldern befasst.

Im Zuge dessen werden Personal, Daten, Fähigkeitsentwicklung, Organisation und Prozesse beleuchtet, abgestimmt, weiterentwickelt und angepasst. Das Risikomanagement zur Gewährleistung einer zuverlässigen und verantwortungsvollen Nutzung von KI-Systemen wird darin beschrieben. Sowohl die EU-KI-Verordnung als auch die Vorgaben der NATO werden insbesondere in Bezug auf Risikomanagement und Prozesse berücksichtigt. Auch die Inhalte der oben aufgeführten internationalen Initiativen für die Governance von Künstlicher Intelligenz im Verteidigungsbereich finden angemessene Berücksichtigung.

Die wirkungsvolle Implementierung der Prinzipien für die verantwortungsvolle Nutzung von KI in der Bundeswehr erfordert dabei im Kern

- die Qualifizierung des Personals zu den Themen KI und Daten,

- die Bereitstellung von qualitätsgesicherten Daten durch das Datenmanagement,

- die Etablierung eines Lifecyclemanagements für die Nutzung von KI, der alle Phasen von der Planung über Rüstung, Validierung, Test und Evaluierung vor Einsatz bis zum laufenden Betrieb und die Aktualisierung der Daten und das Training der KI-Modelle umfasst,

- die Steuerung und Nachhaltung aller Maßnahmen durch eine Governance.

Ziel ist die „AI-Readiness“ der Bundeswehr als Organisation, wie sie von der aktuellen NATO-KI-Strategie gefordert wird. Dafür ist die Bundeswehr mit der Digitalisierungsplattform technisch gut aufgestellt. Die Bundeswehr beginnt keineswegs bei „Null“: Erfahrungen zum Lebenszyklus begleitenden Risikomanagement wurden bereits in Projekten der Bundeswehr, z. B. der KI-unterstützten Krisenfrüherkennung, gesammelt und werden für die weitere Umsetzung ausgewertet und eingebracht.

Die Ausprägung der notwendigen Digitalkultur und neuer Prozesse sowie das Bewahren unserer Werte wird Aufgabe des gesamten militärischen und zivilen Führungspersonals auf allen Ebenen sein.

Zusammenfassung und Ausblick

Die Kriegstüchtigkeit und Zukunftsfähigkeit der Bundeswehr kann im 21. Jahrhundert ohne die verantwortungsvolle Nutzung von Künstlicher Intelligenz nicht erreicht werden. Ihre Vernachlässigung wäre somit eine Gefahr für die Verteidigungsfähigkeit: Durch den Einsatz von Hochgeschwindigkeitswaffensystemen ist jede Millisekunde im Entscheidungsprozess ausschlaggebend, um Angriffe erfolgreich abwehren zu können.

KI-Systeme helfen, Verzögerungen in dynamischen Lagen und Gefechtssituationen zu verringern, Entscheidungsprozesse zu beschleunigen, zivilen Begleitschaden zu vermeiden bzw. zu verringern, Force Protection zu gewährleisten und die Auftragserfüllung sicherzustellen. Bedrohungen können so in ihrer Entstehung erkannt und neutralisiert werden. Die verantwortungsvolle militärische Nutzung von Künstlicher Intelligenz erhöht nicht nur die Letalität der Streitkräfte gegenüber dem militärischen Gegner, sondern ermöglicht auch besseren Schutz der Zivilbevölkerung in allen Operationsphasen.

Die verantwortungsvolle militärische Nutzung von Künstlicher Intelligenz für die Bundeswehr ist eingebunden in die Rechtsordnung, die Werte des Grundgesetzes, das Konzept der Inneren Führung und den Bündnisrahmen von NATO und EU. Das BMVg entwickelt auf dieser Grundlage eine verbindliche Governance für KI in der Bundeswehr und bringt sich aktiv in die Entwicklung einer internationalen Governance für KI im Verteidigungsbereich ein, aus der sich möglicherweise in Zukunft der rechtliche Rahmen für „AI Warfare“ entwickelt.

Autoren:

Oberst i.G. Frank Endler,

Oberstleutnant i.G. Patrick Glaser,

Dr. Jan Ganschow,

Abteilung Innovation und Cyber (Abt IC), Bundesministerium der Verteidigung

Mit WhatsApp immer auf dem neuesten Stand bleiben!

Abonnieren Sie unseren WhatsApp-Kanal, um die Neuigkeiten direkt auf Ihr Handy zu erhalten. Einfach den QR-Code auf Ihrem Smartphone einscannen oder – sollten Sie hier bereits mit Ihrem Mobile lesen – diesem Link folgen: